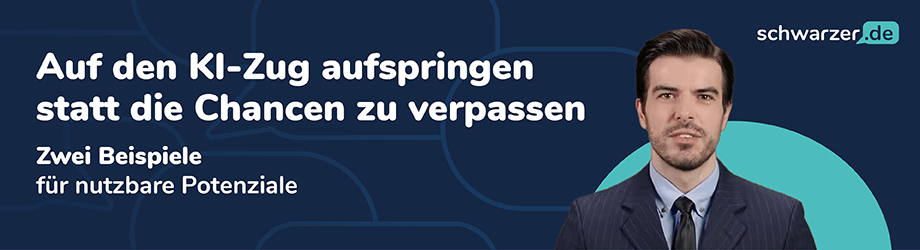

Im zunehmend stärker digitalisierten Unternehmensalltag werden Daten zum entscheidenden Produktionsfaktor. Nur eine perfekt gepflegte Datenbank kann als Grundlage für ein Reporting genutzt werden, das verlässliche Aussagen erlaubt. Obwohl eine allgemeine Einsicht besteht, dass eine qualitativ hochwertige Datenbasis wichtig ist und alle Unternehmensbereiche tangiert, ist nicht immer klar, wie dieses Ziel erreicht werden kann.

Komplexität des Informationsmanagements: Stolpersteine auf dem Weg zu Big Data

Informationen von Kunden, Konkurrenten und dem eigenen Unternehmen in handlungsrelevante Daten zu transferieren, ist mit Business Analytics Tools eine der zentralen Herausforderungen moderner Unternehmensführung. Mit den technologischen Möglichkeiten erweitern sich die Handlungsspielräume des Managements erheblich. Wenn es gelingt, die für eine Entscheidung relevanten Fakten optimal aufzubereiten, kann das Management seine Entscheidungen datenbasiert treffen. Die Unternehmensführung ist nicht mehr davon abhängig, dass das Bauchgefühl stimmt, sondern entscheidet auf Basis verlässlicher Informationen.

Ziel ist das Erreichen von Big Data, also der Nutzung möglichst aller relevanten Informationen aus strukturierten und unstrukturierten Quellen. Auf dem Weg dorthin sind nicht nur technische Schwierigkeiten zu bewältigen. Auch die Frage der Datenqualität ist zu beantworten. Welche Daten sind überhaupt relevant und wie kann sichergestellt werden, dass die Datenbank hinsichtlich der Aktualität und dem Detailierungsgrad optimal aufgebaut ist? Denn jede Medaille hat zwei Seiten: Eine mangelhafte Datenbasis führt dazu, dass das Marketing nicht zielgruppenspezifisch erfolgen kann oder Kunden aufgrund von falschen Rechnungen verärgert werden. Wird der Lagerbestand nicht perfekt gemanagt, drohen Lieferengpässe, die wiederum den Unmut und negative Bewertungen der Kunden nach sich ziehen.

Auf der anderen Seite liegen in einer guten Datenqualität riesige Potentiale. Laut einer Studie von D&B Kanada verliert die US-Wirtschaft jährlich 600 Milliarden Euro, weil die Qualität der Daten in den Firmen nicht ausreichend hoch ist. Wird mit geeigneten Maßnahmen die Datenqualität gesteigert, ergeben sich große Kostensenkungspotentiale, da die Geschäftsprozesse vereinfacht werden und darüber hinaus auch reibungsloser ablaufen.

Besonders in einer wirtschaftlich schwierigen Zeit können vermeintlich kleine Probleme zu großen Krisen führen. Chancen werden verpasst und Risiken zu spät erkannt. In einem dynamischen Umfeld hat das verheerende Folgen, die dazu führen können, dass ein Unternehmen in seiner Wettbewerbsposition geschwächt wird. Neben diesen geschäftlichen Risiken, dürfen auch rechtliche Probleme, die sich aus einer schlechten Datenqualität ergeben, nicht vernachlässigt werden. Probleme mit der Gewährleistung, dem Datenschutz und gesetzlichen Dokumentationspflichten sind ein weiterer Grund, dem Bereich der Datenbereinigung eine größere Beachtung zu schenken.

Wird mit geeigneten Maßnahmen die Datenqualität gesteigert, ergeben sich große Kostensenkungspotentiale, da die Geschäftsprozesse vereinfacht werden und darüber hinaus auch reibungsloser ablaufen.(#01)

Was sind die Kriterien für eine gute Datenbasis?

Zunächst muss die Frage beantwortet werden, was eine hohe Datenqualität generell ausmacht. Erst wenn man sich auf diese Kriterien festgelegt hat, ist es möglich, den Datenbestand dahingehend kritisch zu überprüfen und gegebenenfalls Maßnahmen zur Datenbereinigung zu ergreifen.

Eine verlässliche Database sollte verschiedene Kriterien erfüllen. Zunächst muss die Datenbank selbstverständlich inhaltlich korrekt und aktuell sein. Es dürfen innerhalb der einzelnen Datensätze und auch zwischen den Datensätzen keine Widersprüche bestehen. Es ist außerdem wichtig, dass die Generierung des Datenbestands nachvollziehbar ist und dieser so exakt wie nötig und vollständig vorliegt.

Darüber hinaus sollten keine Dubletten vorhanden sein und genau die Daten erhoben werden, die von Bedeutung, also für die unternehmerischen Entscheidungen relevant, sind. Es ist wichtig, dass alle Datensätze einheitlich strukturiert, verständlich und eindeutig interpretierbar sind. Nur wenn der gesamte Datenbestand diese Anforderungen erfüllt, kann er die Funktion, als Entscheidungsgrundlage zu dienen, auch erfüllen.

Wie kann eine hohe Qualität der Datenbasis erreicht werden?

Es ist sinnvoll, schon bei der Datenerhebung auf die Qualität zu achten. Dies ist wesentlich effektiver, als später eine Dublettenprüfung vorzunehmen oder nach Ungereimtheiten zu suchen. Die Sicherung der Qualität ist nicht nur als technisches Problem zu sehen, sondern sollte als eigenständiger Geschäftsprozess betrachtet werden. Aus diesem Grund ist diese Aufgabe notwendigerweise bei der Geschäftsführung anzusiedeln. Es ist jedoch erforderlich, das gesamte Unternehmen für dieses Problem zu sensibilisieren. Auf jeder Ebene fallen Daten an und somit sollte auch jede Ebene in den Prozess der Datenbereinigung einbezogen werden.

Wie die oben erwähnten Kriterien zeigen, ist eine hohe Qualität des Datenbestands nicht nur darin zu sehen, dass die Daten fehlerfrei sind. Es ist ebenso wichtig, dass die Informationen für den Einsatz als Entscheidungsgrundlage geeignet sind. Können mit der Datenbasis aussagekräftige Berichte im Rahmen von Business Intelligence und Business Analytics erstellt werden?

Bereits auf die Erfassung der Informationen muss ein Augenmerk gerichtet werden, denn Unternehmen nutzen unzählige Datenquellen. Das beginnt mit den Adress- und Zahlungsdaten aus der Kundendatei und endet bei unstrukturierten historischen oder geopolitischen Quellen. Werden neue Datenquellen aufgenommen, muss auch dieser Prozess hinterfragt und hinsichtlich der Auswirkungen auf den Datenbestand beurteilt werden. So stellt sich die Frage, ob neue Informationen dazu führen, dass der Datenbestand bereinigt werden muss. Es kann notwendig werden, die Datenbasis zu ergänzen oder zu aktualisieren. Eine Datenbereinigung kann nur erfolgen, wenn man genau weiß, welche Beziehungen der Informationen untereinander bestehen.

So stellt sich die Frage, ob neue Informationen dazu führen, dass der Datenbestand bereinigt werden muss. (#02)

Wie kann das Verbesserungspotenzial genutzt werden?

Am höchsten ist das Potential für eine Optimierung der Datenbasis in den Firmen, die sowohl die Messung der Datenqualität als auch die Behebung von Problemen manuell vornehmen. Die Anwendung von automatisierten Datenqualitäts-Tools führt in diesen Fällen sehr schnell zu einer erheblichen Steigerung der Qualität. Es sollte jedoch vorher genau definiert werden, welche Verbesserungen angestrebt werden. Besonders die kritischen Prozesse müssen auch im Hinblick auf den Datenfluss optimal abgesichert werden.

Analyse der Datenstrukturen: Data Profiling

Ziel ist es, sich zunächst einen genauen Überblick über den Zustand der Datenbasis zu verschaffen. Es werden Statistiken über die Unternehmensdaten erstellt. Dabei werden die Beziehungen und Inhalte der Datenquellen analysiert. Außerdem werden die Fragen beantwortet, wer die Unternehmensdaten erstellt hat und am häufigsten darauf zugreift.

Resultat ist die Feststellung von Stärken und Schwächen der unternehmensweiten Datenbasis mit einem Datenprofil. Erst wenn dies bekannt ist, können geeignete Maßnahmen zur Verbesserung der Situation ergriffen werden. Mit dem Datenprofil kann anhand von festgelegten Parametern festgestellt werden, wann Abweichungen ein Handeln erforderlich machen.

Verbesserung der Datenqualität

Aufbauend auf die Datenanalyse beim Data Profiling wird begonnen, die Datenbasis zu verbessern. Jetzt werden erkannte Fehler korrigiert und der Datenbestand standardisiert sowie validiert. Damit kontinuierlich an der Verbesserung der Qualität gearbeitet werden kann, sollten in diesem Schritt auch Regeln festgelegt werden. Gelingt es dem Datenqualitätsmanagement, diesen Schritt erfolgreich durchzuführen, wird es möglich, Informationen aus unterschiedlichsten strukturierten und unstrukturierten Quellen auf Vollständigkeit und Präzision zu überprüfen und gegebenenfalls auf das definierte Niveau zu bringen.

Datenintegration für den Aufbau eines Stammdatensatzes

Abweichende Eintragungen aus unterschiedlichen Quellen sollen derart harmonisiert werden, dass ein einziger Stammdatensatz gebildet werden kann. Für diesen Zweck werden Verfahren wie das Fuzzy Matching angewendet und damit unterschiedliche Datenbestände zusammengeführt. Ziel und Ergebnis ist das Erreichen einer vollständigen Datenbasis für ein bestimmtes Objekt. Die angestrebte Einheitlichkeit ermöglicht außerdem, dass verwandte Einträge systemübergreifend erkannt und sinnvolle Verknüpfungen hergestellt werden können.

Abweichende Eintragungen aus unterschiedlichen Quellen sollen derart harmonisiert werden, dass ein einziger Stammdatensatz gebildet werden kann.(#04)

Datenanreicherung zur Optimierung des Informationsgehalts

In diesem Schritt der Datenbereinigung geht es um eine Verbesserung des Informationsgehalts der Datensätze. Man kann die eigenen Kundendaten um Informationen von Geschäftspartnern oder anderen Unternehmen ergänzen. Darüber hinaus ist es möglich, die Unternehmensdaten zum Kundenverhalten mit externen Quellen zu verknüpfen, um zu neuen Aussagen zu gelangen und das Marketing exakter und zielgerichteter durchzuführen. Es lassen sich verschiedene Kausalitäten durchspielen und teilweise treten überraschende Interdependenzen zutage.

Datenbereinigung

Kontrolle der Datenbasis

In jedem Data Governance Programm hat die abschließende und fortlaufende Kontrolle der Datenbasis eine erhebliche Bedeutung. Auf diese Weise werden Probleme schnell erkannt und können dementsprechend umgehend beseitigt werden. Zu diesem Zweck werden automatisierte Data Profiling Reports erstellt. Wird eine zuvor definierte Toleranzgrenze auffälliger Daten überschritten, erfolgt eine automatisierte Meldung. Eine andere Möglichkeit, die ein noch dynamischeres Agieren ermöglicht, sind Web Services. Hier werden die Datenbestände in Echtzeit von der Eingabe über ihre Verwendung im System nach den festgelegten Regeln kontrolliert.

Die Relevanz einer optimierten SAP-Datenqualität

Besonders im Umfeld von SAP stehen die Projekte einer Migration oder Verschmelzung von Daten verschiedener Unternehmen oder Unternehmensbereiche unter enormem Zeitdruck. Außerdem wird wie selbstverständlich eine hohe Erfolgswirksamkeit der Datenbereinigung angenommen. Folge ist eine überhastete Vorgehensweise, bei der nicht ausreichend auf die Qualität der Datenbasis geachtet wird. Besonders im Hinblick auf das Thema Datenqualität ist außerdem festzustellen, dass die SAP-Systeme oft veraltet und den Anforderungen an heutige Datenmengen kaum gewachsen sind. Es bedarf weitreichender Anstrengungen, um die Qualität der Database dauf ein akzeptables Niveau zu bringen.

Auch die modernsten SAP-Systeme sind letztlich vom Input an Informationen aus der Datenbank abhängig. Die Software führt aus und liefert dann Ergebnisse, die so gut oder schlecht sind, wie es die zugrunde liegende Database erlaubt. Die Tatsache, dass die Transaktionen, die mit den SAP-Systemen durchgeführt werden, analog zu steigenden Datenmenge immer komplexer werden, vergrößert gleichzeitig die Risiken, die mit einer schlechten Datenbasis einhergehen.

Wie kann man die Datenbasis in der SAP Software verbessern?

Viele Firmen sind der Überzeugung, dass allein die Investition in eine leistungsfähige SAP Software alle Probleme löst, die mit dem Datenmanagement verbunden sind. Das ist leider aus oben genannten Gründen nicht der Fall. Dennoch ist eine SAP basierte ERP Software eine gute Basis für ein darauf aufbauendes Datenqualitätsmanagement.

Es sind BI-Tools verschiedener Anbieter verfügbar, mit denen ein Master Data Management im Zusammenspiel mit der SAP Software erreicht werden kann. Diese Tools können identifizieren, wo die Stammdaten verwendet werden und welche Belege miteinander in Beziehung stehen. Dabei erfolgt zunächst eine Datenanalyse. Sind die Schwachstellen der Stammdaten gefunden, erfolgt im Rahmen einer Datenbereinigung die Strukturierung, Reorganisation und Anreicherung der Datenbasis sowie eine Dublettenprüfung.

Andere Anbieter ermöglichen über einen Web-Zugriff Services in Echtzeit zu nutzen. Dabei werden vorgefertigte Prozesse direkt in die SAP-Benutzeroberfläche integriert. Besonders die innovative Materialdatenklassifizierung, eine Validierung von Telefonnummern und ein Namens-Parsing erweisen sich für die Firmen als überaus nützlich. Auf diese Weise werden Tippfehler eliminiert. Auch eine automatische Überprüfung jeder neuen Adressanlage führt zu einer höheren Qualität der Database.

Viele Firmen sind der Überzeugung, dass allein die Investition in eine leistungsfähige SAP Software alle Probleme löst, die mit dem Datenmanagement verbunden sind. Das ist leider aus oben genannten Gründen nicht der Fall.(#05)

Auf den Punkt gebracht: der Nutzen eines Master Data Management

Damit die Digitalisierung die gewünschten positiven Effekte nach sich zieht, ist ein integriertes Datenmanagement erforderlich. Besonders die Nutzung unstrukturierter Datenquellen wie die Sozialen Netzwerke stellt das Management vor erhebliche Probleme. Auch die Generierung von Reports, mit denen die Erkenntnisse aus den Datenbeständen erst handlungsrelevant werden, ist ein wichtiger Bereich. Softwarelösungen zur automatisierten Datenbereinigung sollten mit der bestehenden IT-Landschaft kompatibel sein.

Besonders überzeugend sind Ergebnisse des Data Profiling, aus denen direkte Erkenntnisse abgeleitet werden können. Ein Beispiel sind Marketing Kampagnen, die fehlschlagen, weil nachweislich eine unzureichende Kundensegmentierung durchgeführt wurde. Meist lässt sich die Ungenauigkeit der zugrunde gelegten Kundendatei als Ursache wenig effektiver Marketing Anstrengungen identifizieren. Hier wird deutlich, welche Risiken eine mangelhafte Datenbasis hat und welche Chancen die Datenbereinigung bietet.

Ein weiteres Beispiel für den direkten Nutzen der Datenbereinigung ist die Betrachtung von Prozessschwächen, die durch eine schlechte Qualität der Datenbank verursacht werden. Die Beschleunigung der Geschäftsprozesse ist ein wesentlicher Grund für die Notwendigkeit, auf eine saubere Datenbasis zu achten und alle dafür notwendigen Anstrengungen in Kauf zu nehmen.

Besonders der Einkaufsbereich von Unternehmen, die aus mehreren Firmen bestehen, profitiert von einer einheitlichen Klassifizierung von Kaufteilen und Dienstleistungen. So kann das Gesamtunternehmen Bedarfe bündeln und günstiger einkaufen. Auch im Hinblick auf die Kundenbeziehungen, die Basis jeglichen Geschäftserfolgs sind, zahlt sich eine hohe Datenqualität aus. Mit einer fehlerfreien Kundenansprache werden Professionalität und eine hohe Kompetenz signalisiert und Reklamationen entgegengewirkt. Zufriedene Kunden sind nicht zuletzt Multiplikatoren in den Sozialen Netzwerken.

Letztlich ist eine hohe Qualität der Datenbasis kein Selbstzweck, sondern zielt darauf ab, Prozesse reibungslos ablaufen zu lassen und betriebswirtschaftliche Entscheidungen auf Basis eines verlässlichen Datenbestands zu treffen. Außerdem ist die Qualität der Datenbestände für einen intentionsgemäßen Einsatz der BI-Tools unverzichtbar. Ziel ist das erfolgreiche Agieren in einer dynamischen Wettbewerbssituation und die Maximierung des Gewinns. Gelingt es einem Produktionsunternehmen, durch ein effektives Master Data Management seine Materialstämme um lediglich zwei Prozent zu bereinigen, ließen sich Millionenbeträge einsparen. Hier liegt der Anreiz, sich intensiv mit dem Thema „Qualität der atabase“ auseinanderzusetzen.

Bildnachweis:©Shutterstock – Titlbild:XYZ – #01:ChingChing – #02:phipatbig – #03:phipatbig – #04:Lightspring – #05:Toffolo